Введение

При создании приложений на базе больших языковых моделей вы, скорее всего, меняли промпт, запускали его несколько раз и замечали, что результаты стали качественнее. Но объективно ли это улучшение? Без надежных показателей приходится полагаться на интуицию — то, что в отрасли теперь называют вайб-тестированием.

Основная трудность связана с особенностью ИИ-моделей: их непредсказуемостью. В отличие от обычного ПО, где одинаковый ввод всегда дает тот же результат, большие языковые модели выдают разные ответы даже на схожие запросы. Из-за этого стандартные юнит-тесты бесполезны, а разработчики вынуждены полагаться на догадки, чтобы понять, принесли ли изменения реальную пользу.

Здесь на помощь приходит Google Stax — свежий экспериментальный набор инструментов от Google DeepMind и Google Labs. Этот инструмент позволяет разработчикам и дата-сайентистам проверять модели и промпты по индивидуальным требованиям, превращая личные впечатления в воспроизводимые измерения.

Что такое Google Stax

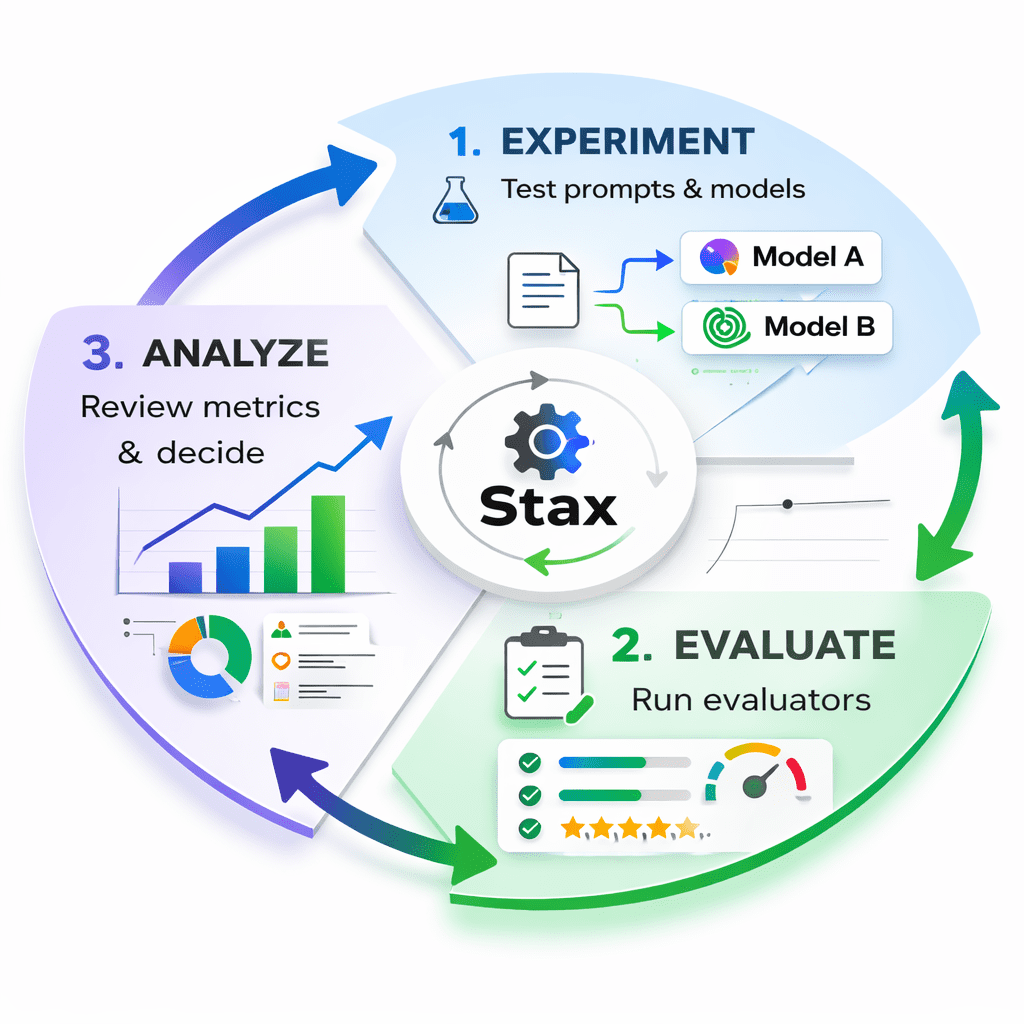

Stax представляет собой платформу для разработчиков, которая упрощает проверку генеративных ИИ-моделей и связанных приложений. Это специализированный фреймворк, заточенный под специфику работы с большими языковыми моделями.

В основе лежит решение ключевой задачи: как определить, какая модель или промпт лучше подходит именно для вашего сценария? Вместо универсальных метрик, не всегда соответствующих задачам проекта, Stax дает возможность задать собственное понятие качества и измерить его.

Основные возможности

- Формирование персональных критериев успеха за пределами стандартных показателей вроде беглости текста или безопасности

- Сравнение разных промптов на множестве моделей параллельно

- Поддержка не только моделей Google Gemini, но и GPT от OpenAI, Claude от Anthropic, Mistral и других через API

Преодоление ограничений общих бенчмарков

Общие тесты ИИ полезны для мониторинга общего прогресса моделей, но они редко учитывают специфику отраслей. Модель, сильная в общих рассуждениях, может провалиться в узких задачах, таких как:

- Суммаризация с акцентом на соблюдение норм

- Анализ юридических документов

- Ответы на вопросы в корпоративной среде

- Соблюдение фирменного стиля бренда

Stax заполняет этот пробел, позволяя оценивать ИИ-системы на основе ваших данных и стандартов, а не абстрактных глобальных рейтингов.

Начало работы со Stax

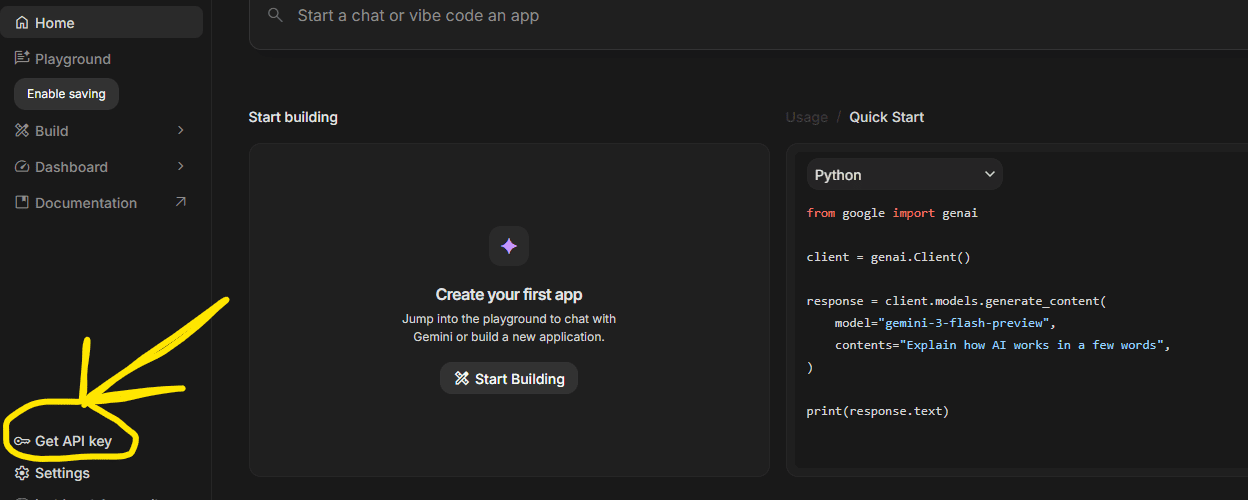

Шаг 1: Добавление API-ключа

Для генерации ответов моделей и запуска проверок потребуется API-ключ. Рекомендуется начать с ключа Gemini API, поскольку встроенные оценщики по умолчанию используют его, хотя их можно перенастроить. Ключ добавляется при первом запуске или в настройках.

Чтобы сравнивать провайдеров, добавьте ключи для нужных моделей — это обеспечит параллельный анализ без переключений.

Шаг 2: Создание проекта оценки

Проекты — это основное рабочее пространство в Stax. Каждый проект посвящен одному эксперименту, например, проверке нового системного промпта или сравнению моделей.

Доступны два типа проектов:

| Тип проекта | Для чего подходит |

|---|---|

| Одна модель | Базовая оценка или тестирование обновления модели/промпта |

| Сравнение бок о бок | Прямое сопоставление двух моделей или промптов на одном наборе данных |

Шаг 3: Формирование датасета

Качественная проверка начинается с точных данных, отражающих реальные сценарии. Stax предлагает два способа:

Вариант А: Ручное добавление в песочнице промптов

Если датасета нет, создайте его с нуля:

- Выберите тестируемые модели

- Задайте системный промпт (по желанию) для роли ИИ

- Добавьте пользовательские запросы, имитирующие реальные

- Укажите оценки людей (опционально) для базовых баллов

Каждый ввод, выход и рейтинг сохраняется как тест-кейс автоматически.

Вариант Б: Загрузка готового датасета

Для команд с производственными данными подойдут CSV-файлы. Если в них нет выходов моделей, нажмите "Generate Outputs" и выберите модель.

Лучшая практика: Включите граничные случаи и противоречивые примеры для полного охвата.

Оценка выходов ИИ

Ручная оценка

Оценки людей можно ставить прямо в песочнице или на бенчмарке проекта. Это золотой стандарт, но метод медленный, дорогой и не масштабируется.

Автоматическая оценка с помощью авт рейтеров

Для массовой обработки Stax применяет подход LLM-as-judge: мощная модель судит выходы другой по вашим правилам.

Есть готовые оценщики для типичных метрик:

- Беглость

- Фактическая точность

- Безопасность

- Соблюдение инструкций

- Краткость

Кастомные оценщики

Готовые оценщики — хороший старт, но кастомные идеальны для специфических нужд.

Они проверяют:

- "Полезен ли ответ, но без излишней фамильярности?"

- "Есть ли в выходе персональные данные (PII)?"

- "Соответствует ли код внутреннему стилю?"

- "Соблюден ли фирменный тон бренда?"

Создание кастомного оценщика: Определите критерии, напишите промпт для судьи с чеклистом, протестируйте на малом наборе с ручными оценками.

Практические сценарии применения

Сценарий 1: Чат-бот для поддержки клиентов

При разработке чат-бота для поддержки нужны:

- Профессиональный тон

- Точные ответы на основе базы знаний

- Отсутствие галлюцинаций

- Решение типичных проблем за три обмена

В Stax загрузите реальные запросы клиентов, сгенерируйте ответы от разных моделей (или версий промптов), создайте оценщик для тона и точности, сравните результаты.

Сценарий 2: Инструмент суммаризации контента

Для новостного суммаризатора важны:

- Краткость (до 100 слов)

- Соответствие фактам оригинала

- Сохранение ключевой информации

Готовый оценщик качества суммаризации даст быстрые метрики, а кастомные добавят контроль длины или стиля бренда.

Анализ результатов

После оценки Stax добавляет в датасет колонки с баллами и обоснованиями для каждого выхода. Раздел метрик проекта агрегирует:

- Ручные оценки

- Средние баллы оценщиков

- Задержки инференса

- Количество токенов

Эти данные помогают:

- Сравнивать итерации: Постоянно ли промпт A лучше B?

- Выбирать модели: Оправдана ли скорость потерей качества?

- Отслеживать прогресс: Улучшают ли оптимизации производительность?

- Находить сбои: Какие входы дают плохие выходы?

Рекомендации по эффективным оценкам

- Начните с малого, расширяйтесь: Десять качественных промптов ценнее сотен случайных. Сфокусируйтесь сначала, потом наращивайте.

- Создавайте регрессионные тесты: Включайте проверки вроде "всегда валидный JSON" или "без упоминаний конкурентов", чтобы изменения не ломали рабочее.

- Формируйте челлендж-сеты: Датасеты для слабых мест, например, для сложных рассуждений.

- Не забывайте о людях: Автоматика масштабируется, но отзывы команды развивают чутье. Захватывайте примеры из ручных тестов для датасетов.

Ответы на частые вопросы

- Что такое Google Stax? Это инструмент от Google для проверки приложений на БЯМ. Он тестирует модели и промпты по вашим стандартам, а не общим тестам.

- Как работает Stax? Через LLM-as-judge: задаете критерии, ИИ-модель ставит баллы. Доступны готовые и кастомные оценщики.

- Какой инструмент Google для создания ML-моделей? Stax фокусируется на оценке, а не обучении. Для создания используйте TensorFlow или Vertex AI, а Stax — для их проверки.

- Что от Google аналогично ChatGPT? Основной чат-ИИ — Gemini (ex-Bard). Stax помогает оптимизировать промпты для него и сравнивать с другими.

- Можно ли обучать ИИ на своих данных? Stax оценивает, а не обучает. Используйте свои данные для тестов предобученных моделей; для обучения — Vertex AI.

Заключение

Вайб-тестирование уходит в прошлое. По мере перехода ИИ от прототипов к продакшену точная оценка выходит на первый план. Google Stax помогает определить качество для вашего случая и измерить его системно.