Luma AI анонсировала Uni-1 — свою первую модель, которая в единой архитектуре сочетает анализ изображений и их создание.

Как и Nano Banana Pro от Google с GPT Image 1.5, Uni-1 использует автотрегрессивный трансформер. Такая система строит контент по порядку, токен за токеном, а не извлекает картинки из шума, как это делают классические диффузионные модели. Текст и изображения проходят через единый канал обработки.

Разработчики отмечают: модель разбирает запросы до старта генерации и прямо в процессе, разбивая запутанные указания и продумывая сцены. Это дает высокую точность соблюдения промптов, и Uni-1 полностью соответствует этому правилу. Например, она берет ряд снимков и создает на их основе свежую композицию.

Сверх простого создания изображений Uni-1 дорабатывает объекты через несколько шагов диалога без потери контекста, меняет фото на более чем 76 художественных стилей, принимает эскизы и графические команды, копирует внешность, ракурсы и layout из образцов в новые работы. В демонстрации она построила полную цепочку кадров от единственного фото, показав, как пианист меняется с возрастом от ребенка до старика.

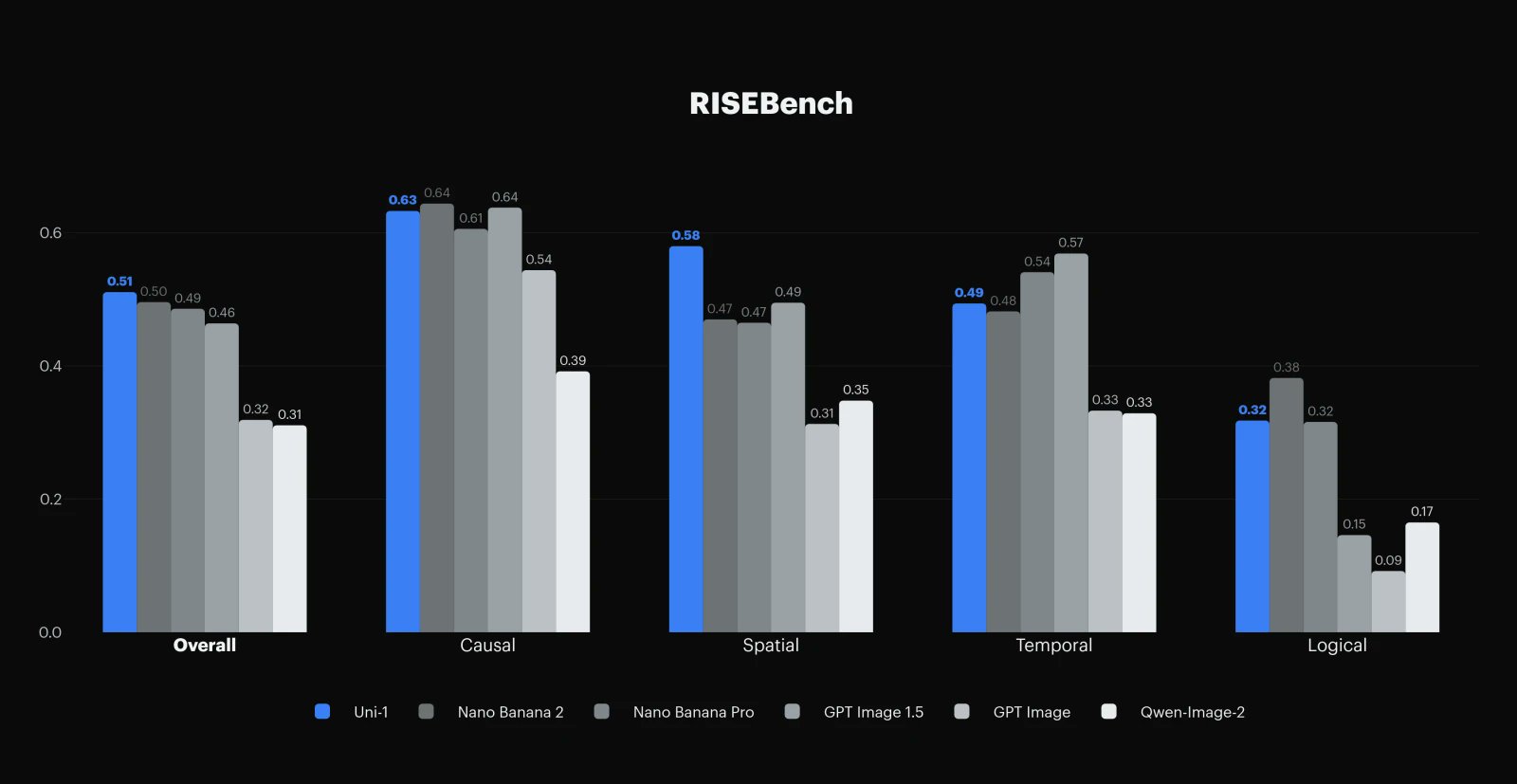

Luma сообщает: Uni-1 показывает лучший результат в RISEBench на задачах логической работы с изображениями, чуть опередив Nano Banana 2 и GPT Image 1.5. Функции генерации усиливают способности к визуальному восприятию. В определении объектов она почти сравнялась с Gemini 3 Pro. Поддержка идет для разных языков.

Uni-1 вскоре запустят в Luma Agents — новом инструменте для творчества, — плюс в Luma API. Детали о стоимости не раскрыты.