AI2 представила MolmoWeb — полностью открытый веб-агент, который ориентируется на сайтах исключительно по скриншотам. Модели с 4 и 8 миллиардами параметров превосходят несколько крупных проприетарных систем в стандартных тестах.

Сейчас ведущие ИИ-агенты для поиска рейсов, заполнения форм или просмотра списков товаров создают компании, не раскрывающие данные обучения или подходы. Институт Аллена по ИИ (AI2) меняет ситуацию с помощью MolmoWeb — полностью открытого агента с доступными данными обучения, весами модели и инструментами оценки. Разработчики отмечают: веб-агенты сегодня похожи на LLM до появления OLMo, сообществу нужен открытый фундамент для развития.

Обучение прошло на комбинации демонстраций от людей и автоматически сгенерированных сессий просмотра с использованием контролируемой дообучки на 64 GPU H100 без reinforcement learning и дистилляции из закрытых систем. MolmoWeb построен на архитектуре Molmo2 с Qwen3 в роли языковой модели и SigLIP2 как энкодер для зрения.

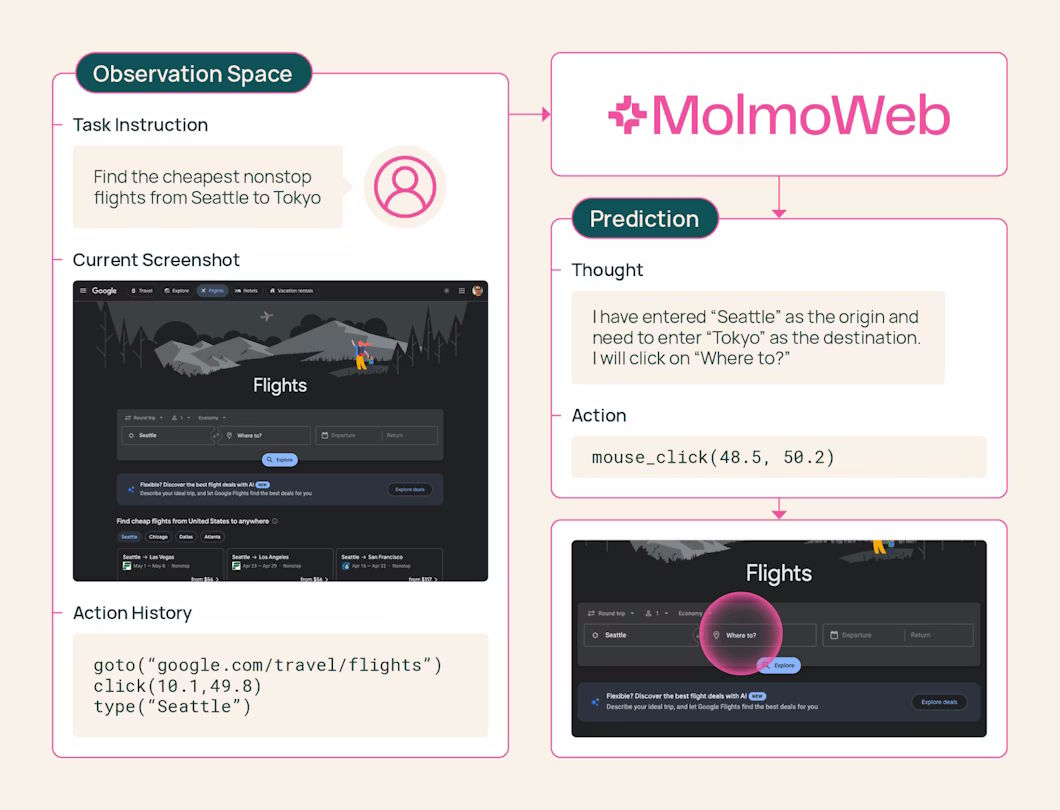

Видит только экран, как человек

Агент делает скриншот текущего вида браузера, определяет следующий шаг и выполняет действие — клик, касание, прокрутку, переключение вкладок или переход по URL. Затем захватывает новый скриншот и цикл повторяется.

MolmoWeb не анализирует исходный код страницы или DOM. Он оперирует только видимым на экране контентом, как это видит человек. По словам создателей, такой подход повышает устойчивость: внешний вид сайта меняется реже, чем его код. К тому же решения агента проще отслеживать.

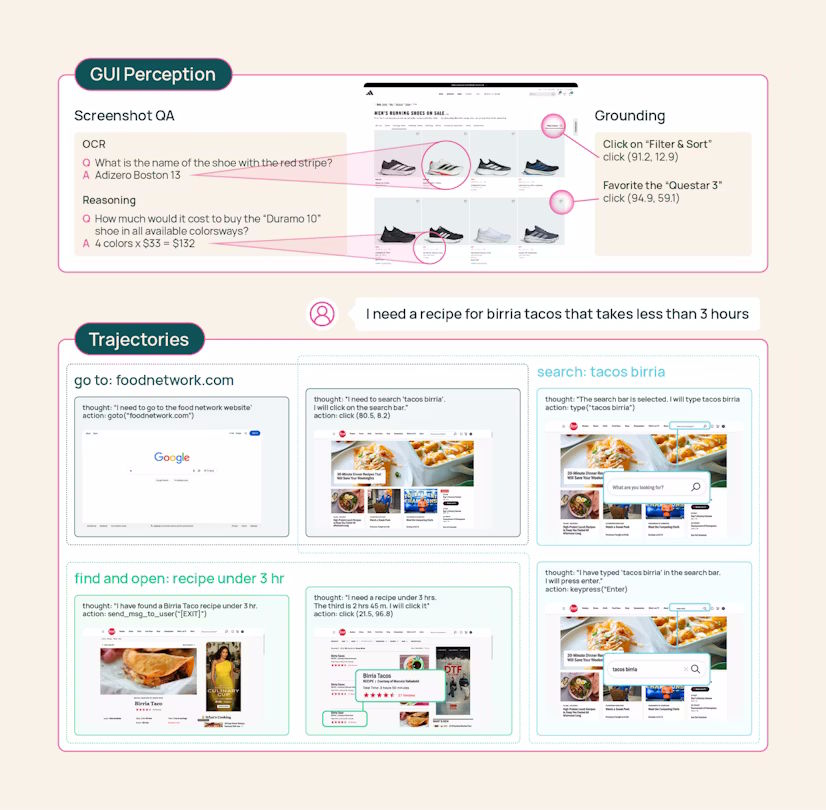

Ключевой вклад — датасет для обучения MolmoWebMix. Главная преграда для открытых веб-агентов — дефицит качественных данных, и этот набор решает проблему.

Сотрудники на краудсорсинговой платформе выполняли реальные задачи в браузере, а команда фиксировала каждый клик и смену страницы — 36 тысяч полных сессий на более чем 1100 сайтах. Это самый большой публичный датасет с человеческими веб-задачами.

Дополнительные траектории создали автоматизированные агенты, чтобы выйти за пределы человеческих аннотаций. Система из трех ролей: планировщик на базе Gemini 2.5 Flash разбивает задачу на подцели, исполнитель проводит действия в браузере, верификатор на GPT-4o проверяет скриншоты на выполнение каждой подцели.

В датасет вошло свыше 2,2 миллиона пар вопрос-ответ по скриншотам для чтения и понимания веб-контента. Локализацию UI-элементов обучали отдельно на наборе из более 7 миллионов примеров.

Неожиданный вывод из сопутствующей статьи: MolmoWeb лучше учится на синтетических траекториях, чем на человеческих демонстрациях для одних и тех же задач. Люди на незнакомых сайтах часто блуждают и отклоняются, а автоматизированные агенты выбирают прямые пути. Аبلляции данных показывают: всего 10 процентов набора дают 85–90 процентов от конечной производительности.

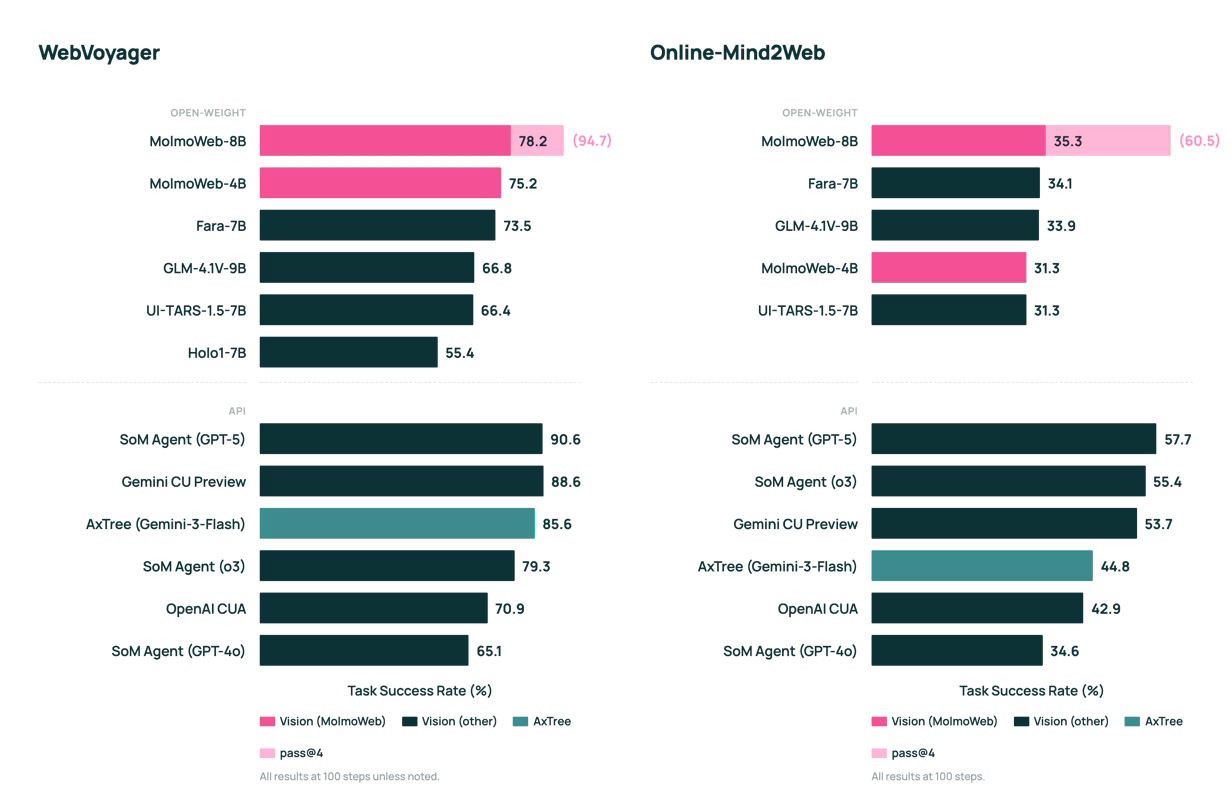

Компактные модели с выдающимися показателями

Несмотря на скромные размеры, обе модели MolmoWeb лидируют среди открытых веб-агентов. На WebVoyager, тестирующем навигацию по 15 популярным сайтам вроде GitHub и Google Flights, вариант 8B набирает 78,2 процента. Это опережает предыдущего лидера среди открытых моделей Fara-7B по всем четырем бенчмаркам и приближается к o3 от OpenAI с 79,3 процента. На DeepShop MolmoWeb-8B отстает от GPT-5 всего на шесть баллов.

MolmoWeb превосходит агентов на значительно более крупном GPT-4o, у которых есть аннотированные скриншоты и структурированные данные страниц, уверяют разработчики. Специализированная модель 8B обходит Claude 3.7 от Anthropic и CUA от OpenAI на бенчмарках ScreenSpot по локализации UI-элементов, хотя AI2 сравнивала с более старыми версиями.

По сравнению со своим «учителем» — агентом на Gemini с доступом к структуре страниц — MolmoWeb отстает на пять баллов. Это плата за подход только со скриншотами: агент сам распознает текст, без готовых подсказок. Разрыв легко сократить: при многократных прогонах задачи и выборе лучшего результата успех на WebVoyager взлетает с 78,2 до 94,7 процента — дополнительные вычисления на этапе инференса окупаются.

Без входов в аккаунты, платежей и с открытыми вызовами

MolmoWeb иногда неверно считывает текст на скриншотах, эффективность падает при расплывчатых инструкциях или множестве ограничений. Команда сознательно исключила задачи с логинами или финансовыми операциями из обучения. В онлайн-демо разрешены только определенные сайты, заблокированы поля паролей и карт, плюс Google-фильтр на вредный контент. Эти ограничения касаются демо, а не самой модели.

Сложные вопросы остаются: как веб-агентам соблюдать условия сервиса? Как запретить доступ к нелегальному контенту или необратимые действия? Разработчики считают: полная открытость позволит большему числу людей решать эти задачи. MolmoWeb доступен на Hugging Face и GitHub по лицензии Apache 2.0.

OpenSeeker недавно применил похожий метод для ИИ-агентов поиска: полностью открытые данные, код и веса против монополии больших компаний на данные. MolmoWeb продлевает тенденцию на автоматизацию браузера.

AI2, продвигающий прозрачный ИИ, недавно потерял несколько ведущих исследователей: Microsoft переманил их в новую команду супер-интеллекта под руководством сооснователя DeepMind Мустафы Сулеймана.