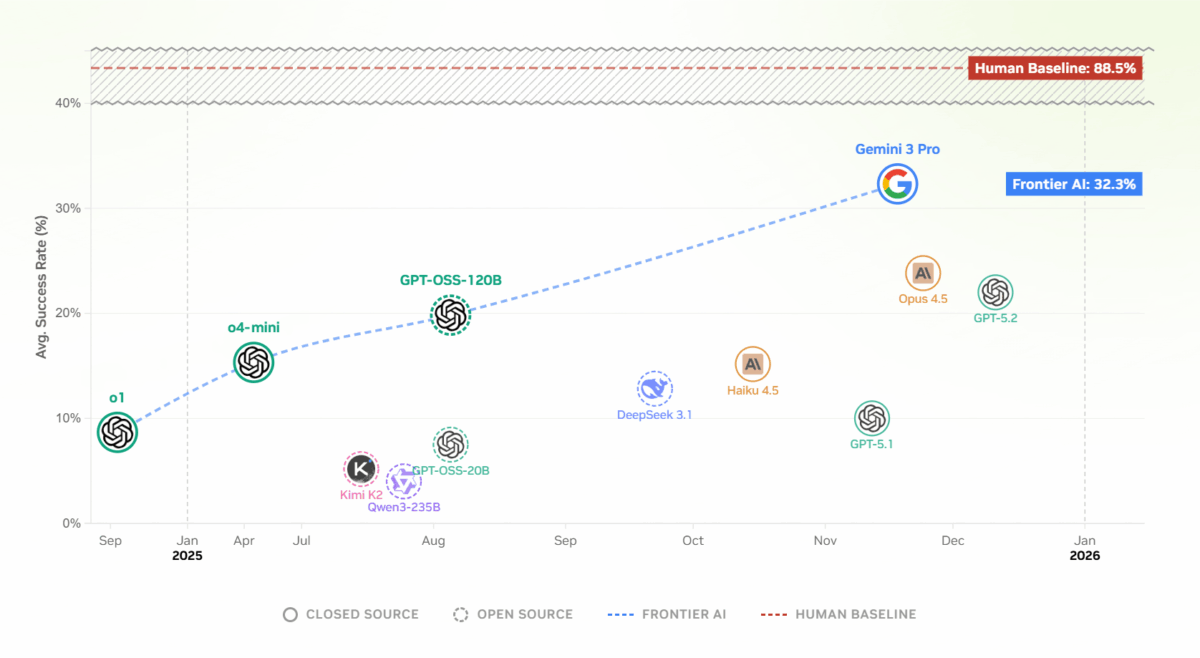

Новый фреймворк от Nvidia, UC Berkeley и Stanford проверяет, насколько эффективно модели ИИ управляют роботами с помощью самостоятельно написанного кода. Вывод: без готовых абстракций созданных людьми даже лидеры рынка терпят неудачу, зато масштабирование вычислений на этапе тестирования и другие подходы существенно сближают результаты.

Специалисты из Nvidia, UC Berkeley, Stanford и Carnegie Mellon представили CaP-X — открытый фреймворк для комплексной оценки способностей ИИ-агентов к написанию программ управления роботами. Главный итог: ни одна из протестированных 12 передовых моделей не достигает стабильности кода, написанного людьми, с первой попытки.

Суть исследования проста: вместо дообучения специализированных моделей на огромных наборах данных с движениями универсальные языковые модели генерируют управляющий код. Чтобы это заработало, авторы применили проверенные на языковых моделях приемы к робототехнике — обучение с подкреплением на основе проверяемых наград из физических симуляций, увеличение вычислений во время теста за счет параллельной генерации решений и самокоррекции, а также шаблоны поведения агентов вроде автоматической отладки и накопления переиспользуемых функций, как у агентов для разработки софта.

В экспериментах задействовали Gemini-3-Pro, GPT-5.2, Claude Opus 4.5 и открытые модели вроде Qwen3-235B и DeepSeek-V3.1. Тестировали на семи задачах манипуляции — от подъема кубика до координации двух рук.

Эффективность сильно меняется в зависимости от доступных конструкций. Если модели получают готовые команды вроде «захвати объект X и подними», им достаточно лишь расставить их в нужном порядке. Но при замене этих удобных функций на базовые операции — сегментацию изображений, обработку глубины, планирование захвата и обратную кинематику — показатели резко падают. Теперь моделям приходится верно соединять десятки строк кода там, где раньше хватало одного вызова функции.

Прямая подача изображений с камеры ухудшает результаты

Забавно, но включение сырых снимков с камеры прямо в контекст моделей дает еще худшие итоги. Авторы предполагают проблему с согласованностью модальностей — базовые модели редко учатся рассуждать одновременно о коде и реальном исполнении на роботе.

Гораздо успешнее промежуточный «Модуль визуальных различий». Отдельная модель зрения-языка сначала описывает сцену текстом, выделяет ключевые свойства задачи, а после каждого шага сообщает об изменениях на изображении и статусе завершения. Этот структурированный текст становится основой для следующей генерации кода агентом. Такой метод стабильно превосходит как сырые логи консоли, так и прямую подачу изображений.

Агент без дообучения достигает уровня человека

На базе этих открытий создали CaP-Agent0 — систему без дообучения с тремя ключевыми частями. Во-первых, упомянутый Модуль визуальных различий для текстового отчета о статусе после шагов. Во-вторых, библиотека функций, которая автоматически собирает полезные блоки из удачных запусков — вроде преобразований координат или фильтров поз захвата — и предлагает их для следующих задач. В-третьих, параллельная генерация кода: создают девять вариантов решений сразу, либо от одной модели при разных температурах, либо распределяя по Gemini-3-Pro, GPT-5.2 и Claude Opus 4.5. Надзорный агент потом объединяет их в итоговый код.

Часть идей восходит к Voyager — агенту для Minecraft от команды соавтора Джима Фана, главы робототехники в Nvidia и со-лидера GEAR Lab, которая стоит за моделями Gr00t компании.

Несмотря на опору только на базовые блоки, CaP-Agent0 не уступает или превосходит человеческий код на четырех из семи задач. Сравнили систему с моделями Vision-Language-Action (VLA), которые управляют роботами через выученные паттерны движений из больших датасетов демонстраций, а не код. На бенчмарке LIBERO-PRO с измененными позициями объектов и перефразированными инструкциями CaP-Agent0 показал результаты близкие к VLA от Physical Intelligence pi0.5 при сдвигах позиций.

При перефразировке описаний задач CaP-Agent0 оказался заметно устойчивее, поскольку напрямую понимает инструкции, а не полагается на конкретное распределение из обучения.

Обучение с подкреплением резко усиливает малую модель

Помимо CaP-Agent0 без дообучения фреймворк предлагает CaP-RL — способ улучшения языковых моделей для робототехники через обучение с подкреплением. Модель получает награды из симуляций физики: успешное движение от сгенерированного кода приносит положительный сигнал.

Модель Qwen2.5-Coder-7B после такого обучения подняла успех в укладке кубиков с 4 до 44 процентов в симуляции. На реальном роботе Franka та же модель достигла 76 процентов без дополнительной настройки, поскольку оптимизирует через абстрактные интерфейсы программирования, а не изображения с камеры. Разница между симуляцией и реальностью почти не влияет.

Авторы предлагают гибридные системы, где агенты-кодеры берут логику задач высокого уровня и восстановление, а специализированные VLA-политики — точное управление моторами. Полный фреймворк CaP-X — включая CaP-Gym, CaP-Bench, CaP-Agent0 и CaP-RL — доступен как открытая платформа для исследователей.