Китайская компания Zhipu AI представила GLM-5V-Turbo — свою первую мультимодальную базовую модель для кодинга. Она работает с изображениями, видео и текстом, специально адаптирована под сценарии с агентами.

С помощью GLM-5V-Turbo разработчики стремятся стереть грань между пониманием визуального контента и созданием кода. Модель не ограничивается текстовыми описаниями: она разбирает дизайн-макеты и сразу выдает готовый исполняемый код. По словам Zhipu AI, она легко интегрируется в агенты вроде Claude Code и OpenClaw, обеспечивая полный цикл: анализ окружения, планирование шагов и выполнение заданий.

Контекстное окно модели вмещает 200 000 токенов, а максимальный объем вывода достигает 128 000 токенов. Поддерживаются режим размышлений, потоковый вывод, вызовы функций и кэширование контекста.

Как модель сочетает зрение и генерацию кода

Z.AI добилась высоких показателей GLM-5V-Turbo благодаря доработкам в четырех направлениях: архитектуре модели, методах обучения, подготовке данных и инструментарии.

С самого начала обучения модель осваивает совместную обработку изображений и текста, без добавления отдельного модуля распознавания к уже готовой языковой модели. Для этого создали новый визуальный энкодер CogViT. Кроме того, во время вывода модель предсказывает сразу несколько токенов, что ускоряет генерацию.

Обучение с подкреплением улучшает производительность по более чем 30 типам задач, включая STEM, заземление, видео, GUI-агенты и кодинг-агенты. Это повышает надежность восприятия, рассуждений и автономного выполнения.

Чтобы компенсировать нехватку данных для агентов, Z.AI разработала многоуровневую систему данных с контролем и верификацией. Навыки агентов закладываются еще на этапе предобучения, усиливая прогнозирование действий и их реализацию.

Новая мультимодальная цепочка инструментов расширяет возможности агента за пределы текста к визуальным взаимодействиям. Инструменты для рисования рамок, скриншотов и чтения сайтов, плюс понимание изображений, замыкают цикл восприятия-планирования-выполнения.

Лидерство в бенчмарках по кодингу и GUI-агентам

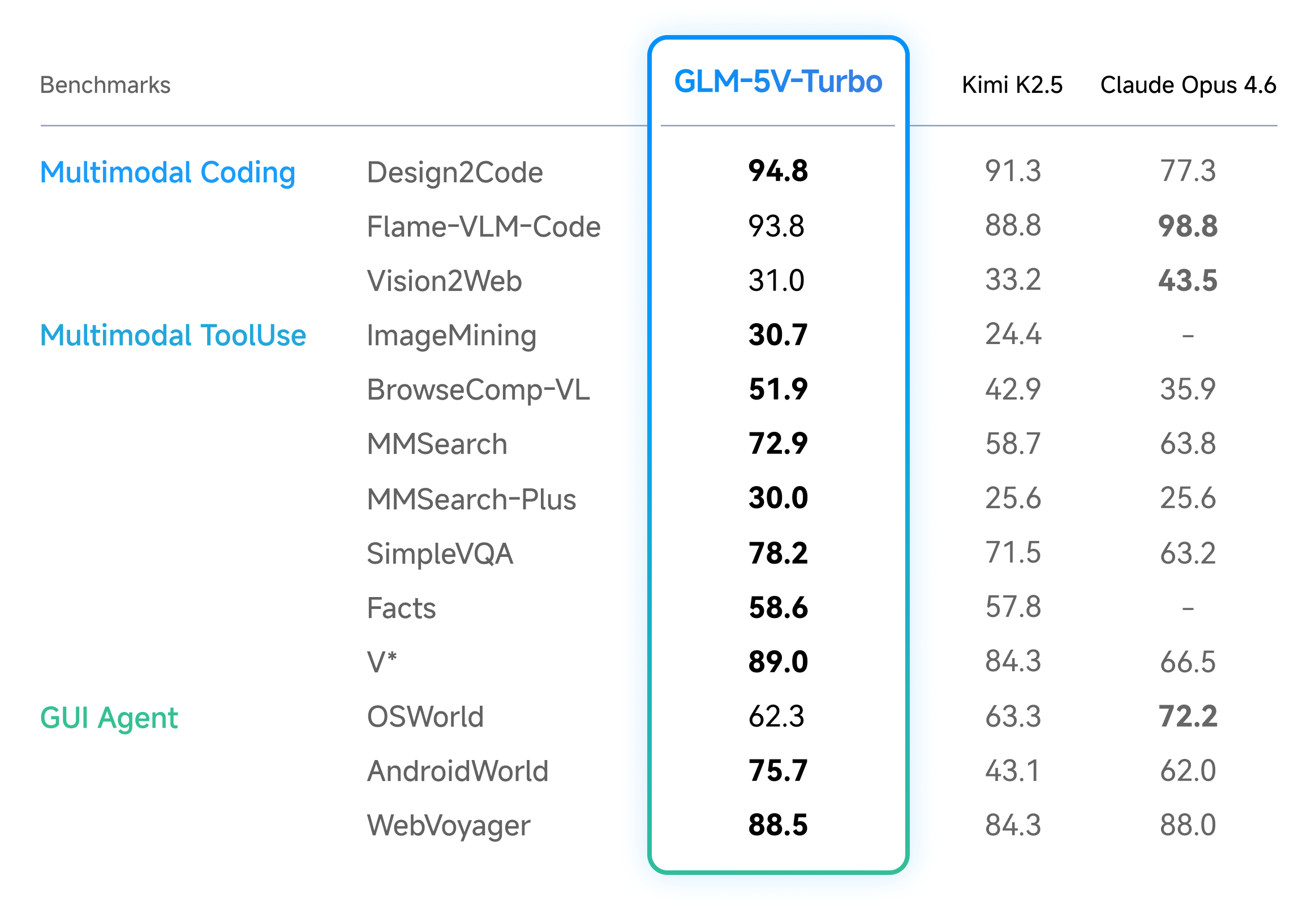

Z.AI заявляет, что GLM-5V-Turbo лидирует в задачах мультимодального кодинга и работы агентов. Модель показывает отличные результаты в генерации кода из дизайнов, визуальной генерации кода, мультимодальном поиске и визуальном исследовании. Она преуспевает на AndroidWorld и WebVoyager — тестах на навигацию в реальных GUI-средах.

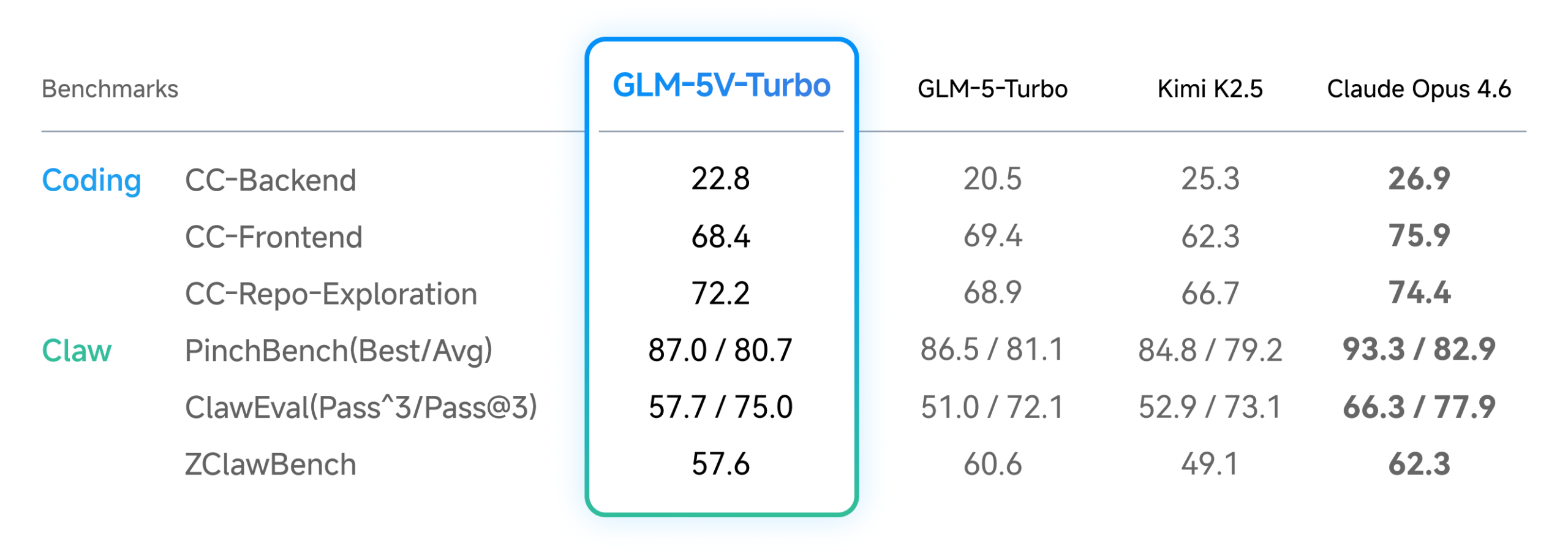

В чисто текстовых задачах по кодингу визуальные возможности не ухудшили производительность: модель держится на уровне трех ключевых бенчмарков CC-Bench-V2 (бэкенд, фронтенд, исследование репозиториев). Она также сильна на PinchBench, ClawEval и ZClawBench, оценивающих качество выполнения задач. Независимые тесты пока не проводились.

Из макетов дизайна — в полноценные фронтенд-проекты

GLM-5V-Turbo ориентирована на конкретные сценарии. Она берет дизайн-макеты или референсные изображения и создает полный запускаемый фронтенд-проект. Модель восстанавливает структуру вайрфрейма и функциональность, стремясь к идеальному совпадению пикселей с высокодетальными дизайнами.

В связке с фреймворками вроде Claude Code модель самостоятельно исследует GUI: ищет целевые сайты, отслеживает переходы страниц, собирает визуальные активы и детали взаимодействий, затем пишет код. Z.AI называет это переходом от "пересоздания по скриншоту" к "пересозданию через автономное исследование".

Для отладки модель делает скриншоты проблемных страниц, выявляет ошибки вроде сдвигов布局, наложений компонентов и несоответствий цветов, предлагает код исправлений. С интеграцией GLM-5V-Turbo OpenClaw понимает layouts сайтов, GUI-элементы и диаграммы, решая сложные задачи, сочетающие восприятие, планирование и исполнение.

Z.AI предоставляет официальные навыки: описание изображений, визуальное заземление, написание на основе документов, скрининг резюме и генерацию промтов. Они доступны на ClawHub. GLM-5V-Turbo пока только через API платформы Z.AI по цене $1.20 за миллион входных токенов и $4 за миллион выходных — как у текстовой GLM-5-Turbo, чуть дороже базовой GLM-5. Открытые веса модели не анонсированы.

GLM-5-Turbo и GLM-5 подготовили почву

Недавно Z.AI выпустила GLM-5-Turbo — текстовую модель для фреймворка OpenClaw. Она усиливает вызовы инструментов, следование инструкциям, задачи с контролем времени, постоянные задания и длинные цепочки.

Вместе с ней представили ZClawBench — комплексный бенчмарк для агентов в экосистеме OpenClaw. GLM-5-Turbo сильно обходит предшественницу GLM-5 и побеждает Claude Opus 4.6, Gemini 3.1 Pro, MiniMax M2.5, Kimi K2.5 в ряде категорий. Доля использования навыков в OpenClaw выросла с 26 до 45 процентов, что указывает на подъем модульных систем агентов, по словам Z.AI.

Ранее Zhipu AI выпустила GLM-5 в середине февраля: открытую модель с 744 миллиардами параметров под лицензией MIT. Компания утверждает паритет с Claude Opus 4.5 и GPT-5.2 по кодингу и агентам. GLM-5 набрала 77.8% на SWE-bench Verified, чуть отставая от 80.9% у Claude Opus 4.5. Модель работает на чипах Huawei и других китайских, помимо Nvidia GPU, — преимущество на фоне экспортных ограничений США.

Alibaba идет похожим путем с Qwen3.5-Omni — омнимодальной моделью для текста, изображений, аудио и видео. Как GLM-5V-Turbo, она генерирует код из визуалов, но также понимает голосовые команды.