Введение

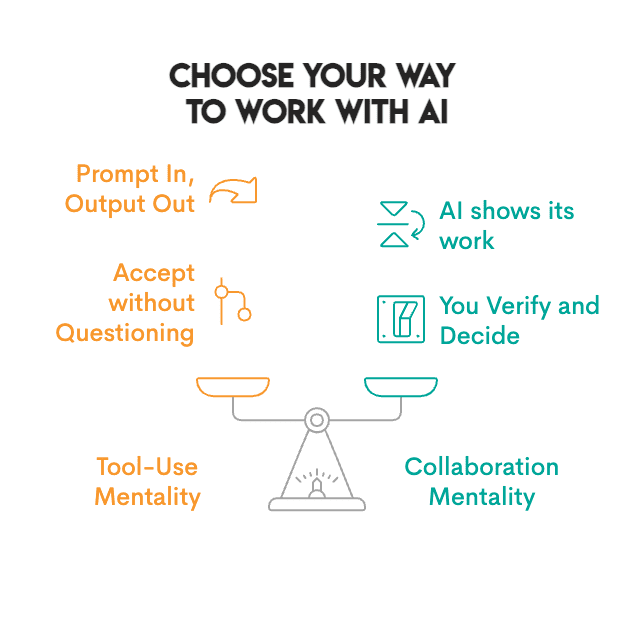

Среди тех, кто готовится к собеседованиям на позиции дата-сайентистов, распространена практика: отправить запрос модели, получить ответ и сразу перейти дальше. Редко кто проверяет результат или задумывается над причинами.

А вот команды, стоящие за самыми передовыми проектами, нашли другой подход к совместной работе. Они создают условия, где ИИ и люди вместе принимают решения. Искусственный интеллект предлагает варианты, выявляет закономерности, отмечает моменты, требующие внимания. Он демонстрирует свой процесс, чтобы можно было все проверить. Люди оценивают, вносят дополнительные знания и выносят окончательное решение. Ни одна сторона не отдает приказы другой.

Примеры из реальной практики

Это не гипотеза — такие процессы уже применяются.

Изменения в научных исследованиях и медицине

AlphaFold создает предсказания структуры белков, на которые в лаборатории ушли бы годы. Но интерпретация этих предсказаний, их ценность и план следующих экспериментов остаются за экспертами-людьми.

Биотехнологическая фирма Insilico Medicine пошла дальше. Обычно поиск подходящего соединения занимает 4–5 лет. Компания разработала платформу на базе ИИ, которая генерирует и отбирает тысячи молекул-кандидатов, оценивая их эффективность. Затем химики-органики изучают лидеров, корректируют формулы и запускают тесты для подтверждения. Итог впечатляющий: время на поиск лидера сократилось примерно на 75% — с 4–5 лет до 18 месяцев.

Похожий подход в патологии. PathAI изучает образцы тканей для выявления рака и других болезней. Патологоанатомы проверяют выводы ИИ и дополняют их своим опытом для постановки диагноза. Исследование Beth Israel Deaconess Medical Center показало точность диагностики рака на уровне 99,5% против 96% при самостоятельной работе патологоанатома. Время на анализ срезов тоже сильно уменьшилось. ИИ замечает шаблоны, которые человек мог пропустить из-за усталости, а специалисты добавляют медицинский контекст.

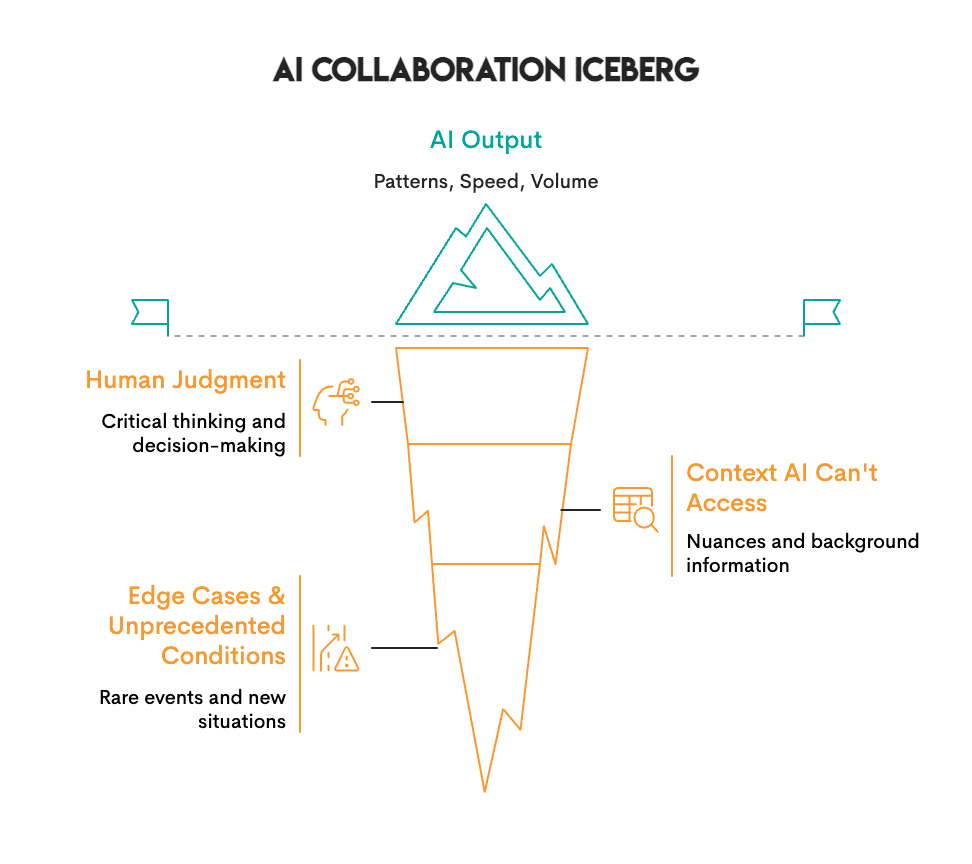

ИИ мастерски находит паттерны — справляется с большими объемами на высокой скорости. Люди сильны в оценке и контексте: они решают, важны ли эти паттерны.

AlphaFold рассчитывает структуры белков за часы вместо лет в лабораториях, но ученые определяют их значение и выбирают эксперименты. ИИ Insilico генерирует тысячи молекул, а химики решают, какие синтезировать. PathAI отмечает подозрительные клетки массово, но патологоанатомы подводят клинический итог.

В каждом примере успех пришел от комбинации усилий ИИ и людей.

Улучшение бизнес-решений

ИИ за часы выполняет то, на что у команд уходили недели: проверка тысяч контрактов, оценка рисков на глобальных рынках, поиск тенденций в данных о использовании. Но интерпретация и действия — на людях.

Например, в JPMorgan Chase юристы тратили 360 000 часов в год на ручной разбор контрактов — медленно, дорого и с ошибками. Они запустили COiN, платформу на базе обработки естественного языка (NLP) и машинного обучения. Она извлекает ключевые моменты, находит необычные пункты и классифицирует условия за секунды. Юристы все равно проверяют отмеченное. В итоге обработка ускорилась, ошибки соответствия сократились на 80%, а время юристов ушло на переговоры и стратегии вместо чтения.

Другой случай — BlackRock, крупнейший управляющий активами с $21,6 трлн под контролем. На таком масштабе анализ миллионов рисковых сценариев по рынкам вручную невозможен. BlackRock создала Aladdin (Asset, Liability, Debt, and Derivatives Investment Network) — платформу ИИ для сбора рыночных данных и прогнозирования рисков. Портфельные менеджеры изучают аналитику и распределяют активы. Теперь анализ в реальном времени вместо дней. Портфели на базе Aladdin с человеческим контролем превосходят чисто алгоритмические и чисто ручные. Более 200 финансовых организаций используют Aladdin.

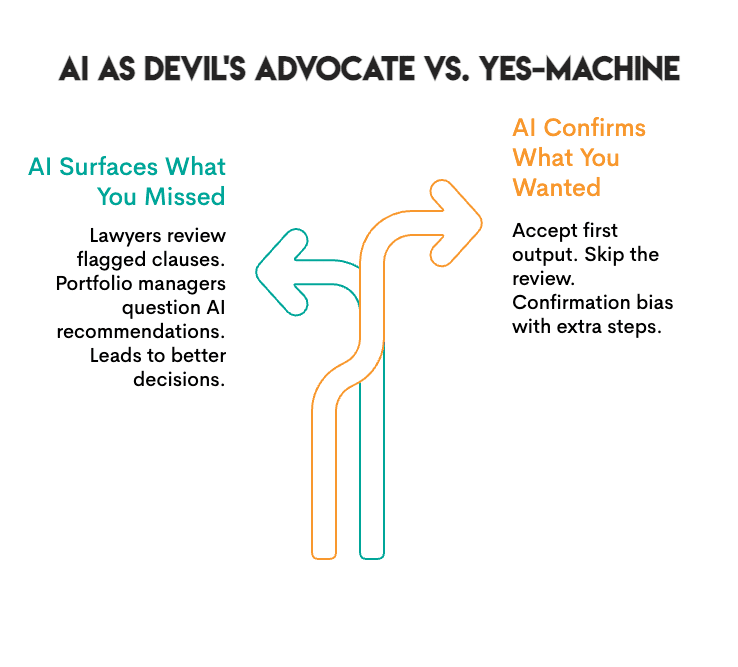

Схема очевидна: ИИ предоставляет данные и варианты в большом объеме. Но он не укажет на ошибку — это задача человека. Юристы JPMorgan проверяют флаги COiN, менеджеры BlackRock принимают финальные решения.

Обзор инструментов для совместной работы

Не все ИИ-инструменты подходят для партнерства. Одни выдают результат как "черный ящик", другие созданы для взаимодействия. Вот инструменты, поддерживающие сотрудничество:

Универсальные ассистенты

- Claude / ChatGPT: Разговорные ИИ, которые комментируют логику, отмечают неясности и признают неуверенность. Это ближайшее к настоящему диалогу.

Поиск и анализ

- Elicit: Ищет научные статьи, извлекает выводы с доказательствами, чтобы можно было оценить данные.

- Consensus: Обобщает литературу, показывает共识 и разногласия ученых для полного обзора.

- Perplexity: Дает результаты поиска с цитатами, каждая связана с источником.

Кодинг и разработка

- GitHub Copilot: Предлагает дополнения кода. Человек проверяет, принимает или меняет; ничего не запускается без согласия.

- Cursor: Редактор кода с ИИ. Показывает diff изменений заранее.

- Replit: Объясняет код, предлагает правки, помогает с отладкой. Контроль за деплоем остается за пользователем.

Рабочие процессы дата-сайентистов

- Julius: Анализирует данные, строит визуализации с показом кода для проверки.

- Hex: Коллаборативная среда для данных с ИИ-поддержкой для команд.

- DataRobot: AutoML-платформа с объяснениями моделей, важностью фич и уверенностью предсказаний.

Письмо и коммуникация

- Notion AI: Встроен в workspace для черновиков, саммари, идей — выбор за человеком.

- Grammarly: Предлагает правки с объяснениями; каждая принимается или отвергается отдельно.

Эти инструменты отличаются прозрачностью: показывают процесс, позволяют проверить и не навязывают результат. Это разделяет инструмент и партнера.

Как оценить эффективность сотрудничества

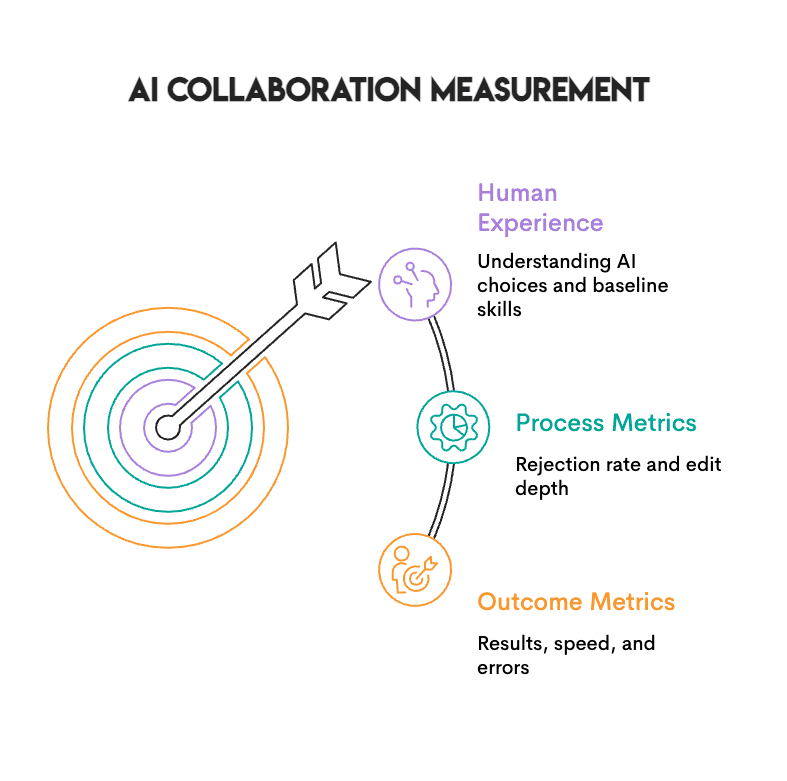

Три вида метрик помогают понять, работает ли партнерство человека и ИИ:

- Метрики результатов просты: улучшились ли итоги, ускорился ли процесс, меньше ли ошибок? Их стоит отслеживать.

- Метрики процесса важнее: если никогда не отвергаешь выводы ИИ, это не признак качества, а сигнал, что ты перестал анализировать.

- Опыт человека тоже ключевой: можешь ли добиться того же без ИИ? Понимаешь ли причины выбора ИИ или просто соглашаешься?

Проверка: полное принятие первого вывода ближе к штамповке, чем к партнерству. Периодическая работа без ИИ сохраняет基准, показывая вклад каждого.

Практики для успешного внедрения

Успешные команды придерживаются общих правил:

- Четкие роли: ИИ генерирует варианты, человек выбирает лучший. Так задействуется генерация идей ИИ при сохранении контроля.

- Контрольные точки: не пропускай выводы ИИ дальше без паузы. Короткий анализ причин выбора обязателен; без объяснения — отказ.

- Прозрачность: бери инструменты, раскрывающие код, источники, изменения. Без видимости процесса верификация невозможна.

- Сохранение навыков: иногда работай без ИИ для сравнения и готовности к сбоям.

Итоговые выводы

Сотрудничество человека и ИИ — настоящий прорыв. Мы учимся общаться с системами, которые дают предложения, а не слепо выполняют команды.

Для успеха нужны навыки: различать, когда доверять ИИ, а когда проверять. Важно оценивать процессы на реальные результаты, а не иллюзию продуктивности. Главное — оставаться бдительным, чтобы ловить ошибки.

Команды, освоившие партнерство с ИИ, достигают лучших итогов: быстрее находят ошибки, рассматривают неожиданные варианты. Те, кто не развивает эти умения, либо упускают пользу, либо становятся зависимыми.

Ответы на частые вопросы

В чем разница между использованием ИИ как инструмента и сотрудничеством с ним?

Инструмент выполняет команду, и результат принимается. В партнерстве ИИ раскрывает процесс — источники, код, логику — для проверки, корректировки или отказа. Без прозрачности настоящего сотрудничества нет.

Как избежать чрезмерной зависимости от ИИ?

Регулярно работай без ИИ и проверяй, можешь ли объяснить его выборы. Если всегда берешь первый вариант или сильно проседаешь без помощи — зависимость налицо.

Оценивают ли это на собеседованиях?

Да. Интервьюеры наблюдают взаимодействие с ИИ: слепое принятие советов — плохой знак, проверка и корректировка — признак сильного суждения.