Введение

Сегодня для работы с мощными моделями ИИ локально не нужно мощное оборудование или платные облачные сервисы. Благодаря компактным инструментам и открытым моделям небольшого размера даже старый ноутбук превращается в полноценную среду для программирования, экспериментов и задач в стиле агентов.

В этом руководстве описано, как запустить Qwen3.5 с помощью Ollama и связать ее с OpenCode, чтобы получить базовый локальный агентный комплекс. Подход простой, подходит новичкам и не требует сложных настроек — в итоге вы получите готового локального ИИ-помощника.

Установка Ollama

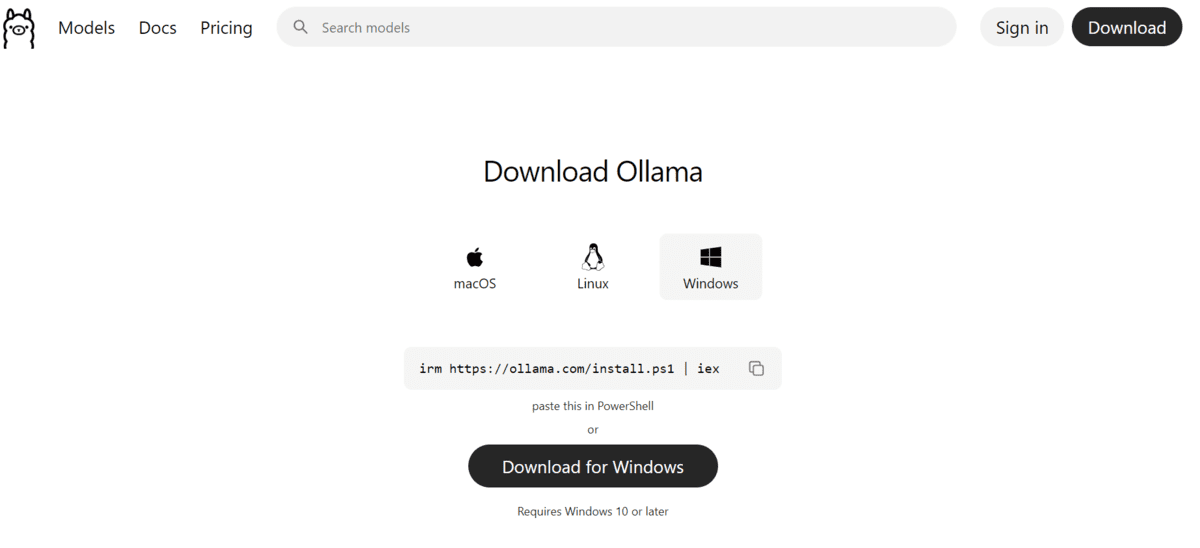

Сначала нужно установить Ollama — инструмент, который упрощает запуск больших языковых моделей прямо на компьютере.

Для Windows скачайте установщик с официальной страницы загрузки Ollama для Windows и запустите его как обычную программу. Альтернатива — выполните в PowerShell такую команду:

irm https://ollama.com/install.ps1 | iex

На сайте Ollama есть инструкции по установке для Linux и macOS — следуйте им при необходимости.

После завершения установки Ollama готов к работе, и можно загружать первую модель.

Запуск Ollama

Обычно Ollama стартует сам сразу после установки, особенно при первом запуске. Так что модель можно запускать без дополнительных действий.

Если сервер Ollama не активен, активируйте его командой:

ollama serveЗапуск Qwen3.5 локально

Когда Ollama работает, переходите к загрузке и запуску Qwen3.5.

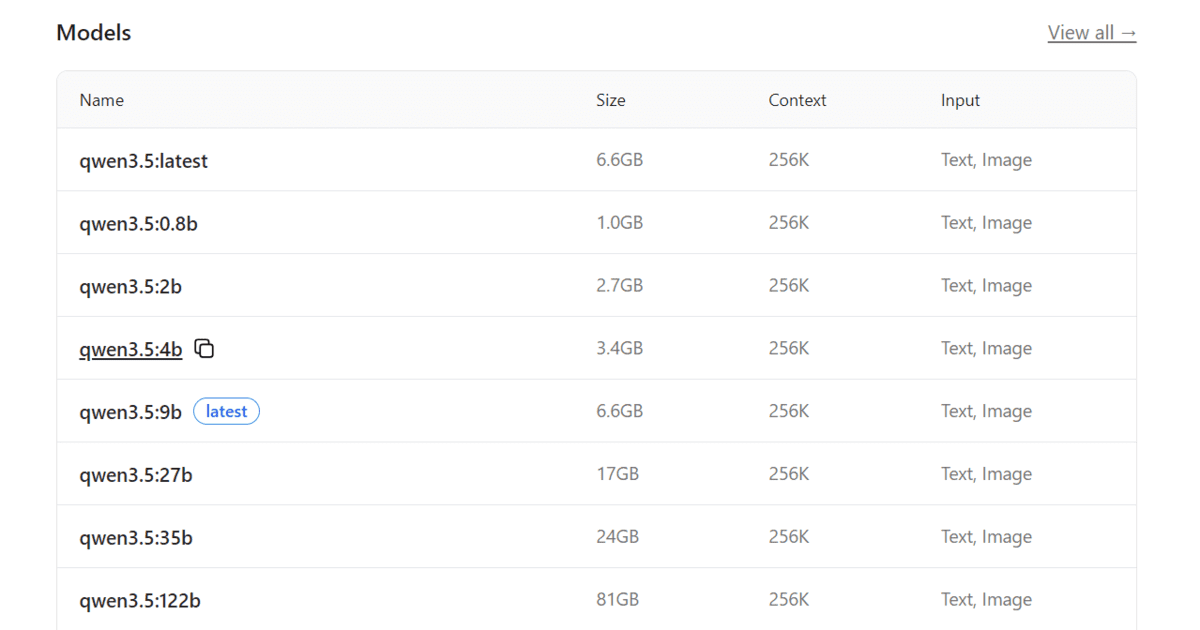

На странице модели Qwen3.5 в библиотеке Ollama доступны варианты разного объема — от крупных до компактных.

Мы выберем версию 4B: она сочетает хорошую производительность с минимальными требованиями к железу, подходит для старых ноутбуков и занимает около 3.5 ГБ оперативной памяти.

В терминале выполните:

ollama run qwen3.5:4bПри первом запуске Ollama скачает файлы модели — время зависит от скорости интернета, обычно несколько минут.

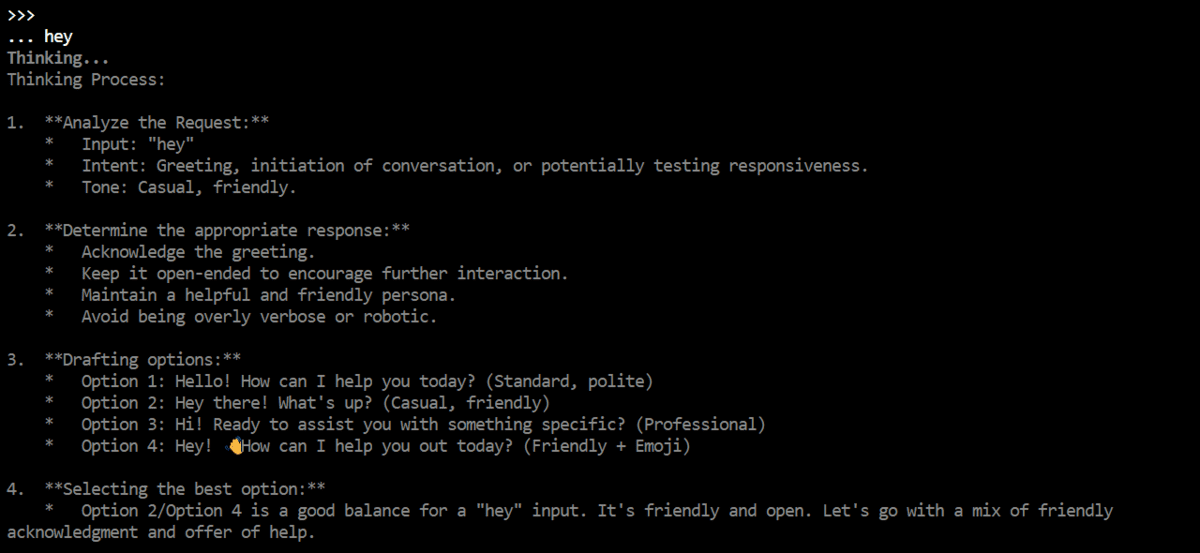

Затем модель загрузится в память, и откроется чат-интерфейс в терминале для прямого общения с ней.

Теперь Qwen3.5 готова к простым диалогам, тестам и помощи в кодинге прямо в терминале — до подключения к OpenCode для агентных функций.

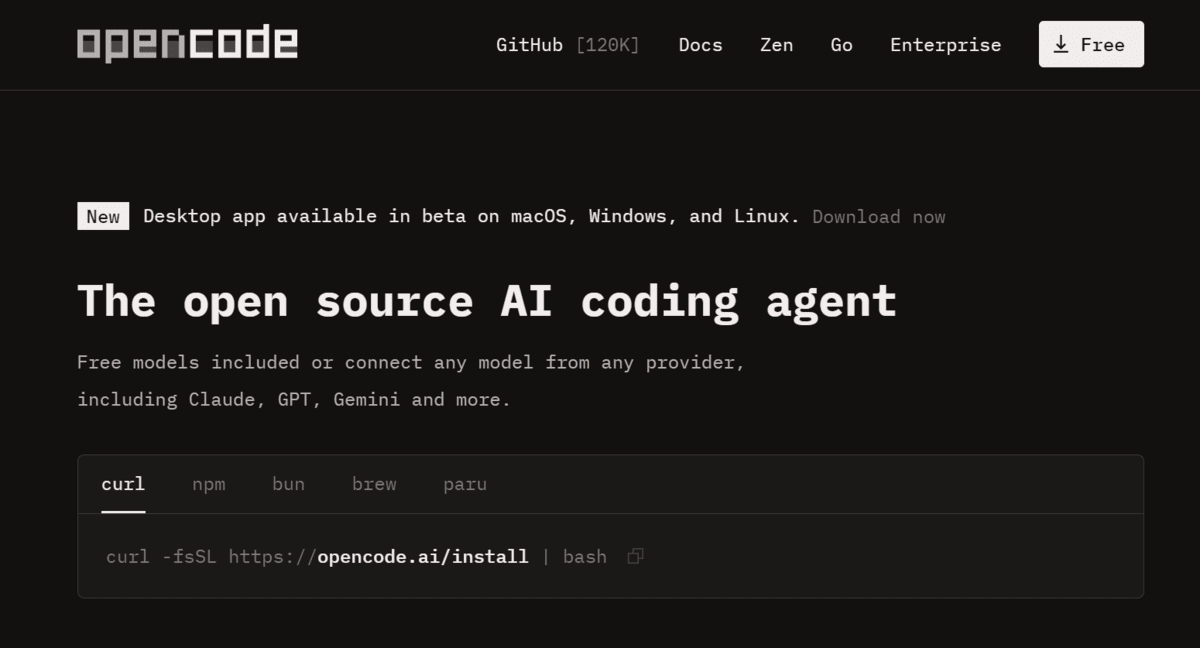

Установка OpenCode

С установленными Ollama и Qwen3.5 устанавливаем OpenCode — локального кодингового агента, совместимого с моделями на вашем ПК.

На сайте OpenCode посмотрите варианты установки; мы используем самый быстрый.

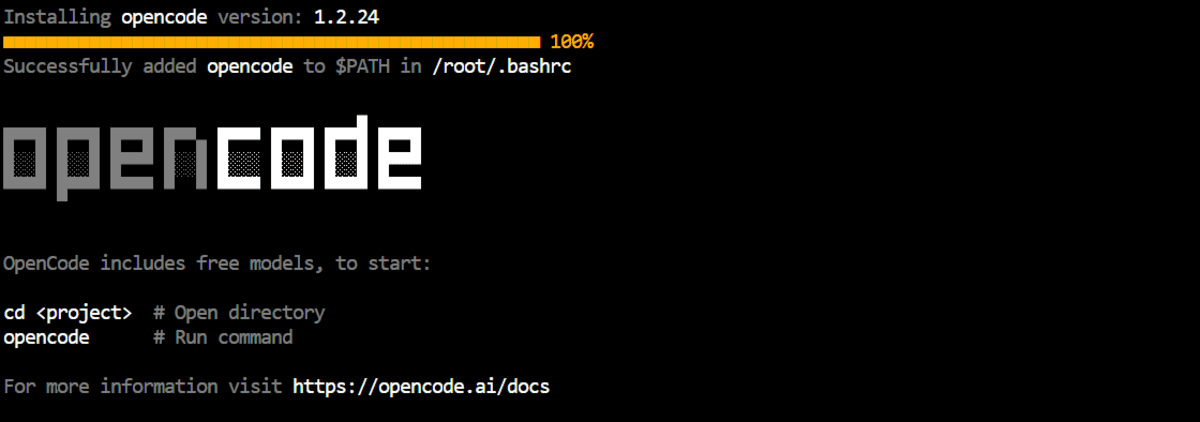

В терминале запустите:

curl -fsSL https://opencode.ai/install | bashСкрипт сам установит зависимости, включая Node.js, без ручной настройки.

Запуск OpenCode с Qwen3.5

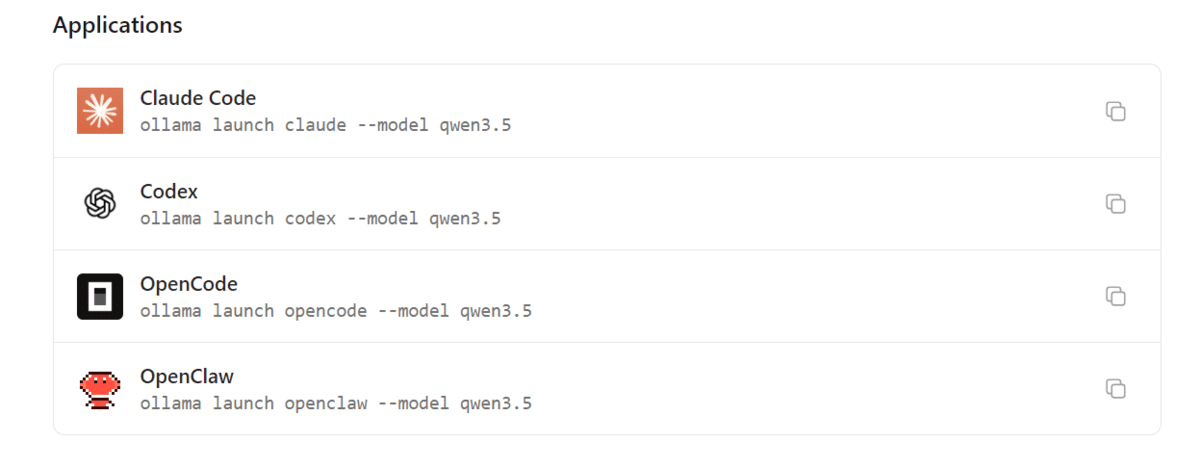

Теперь связываем OpenCode с локальной Qwen3.5, чтобы использовать как кодингового агента.

Страница Qwen3.5 в Ollama показывает поддержку интеграций с внешними инструментами — это упрощает переход от терминального чата к полноценным рабочим процессам.

Для запуска:

ollama launch opencode --model qwen3.5:4bКоманда активирует OpenCode с вашей моделью Qwen3.5 4B, и вы попадете в интерфейс с готовой связкой.

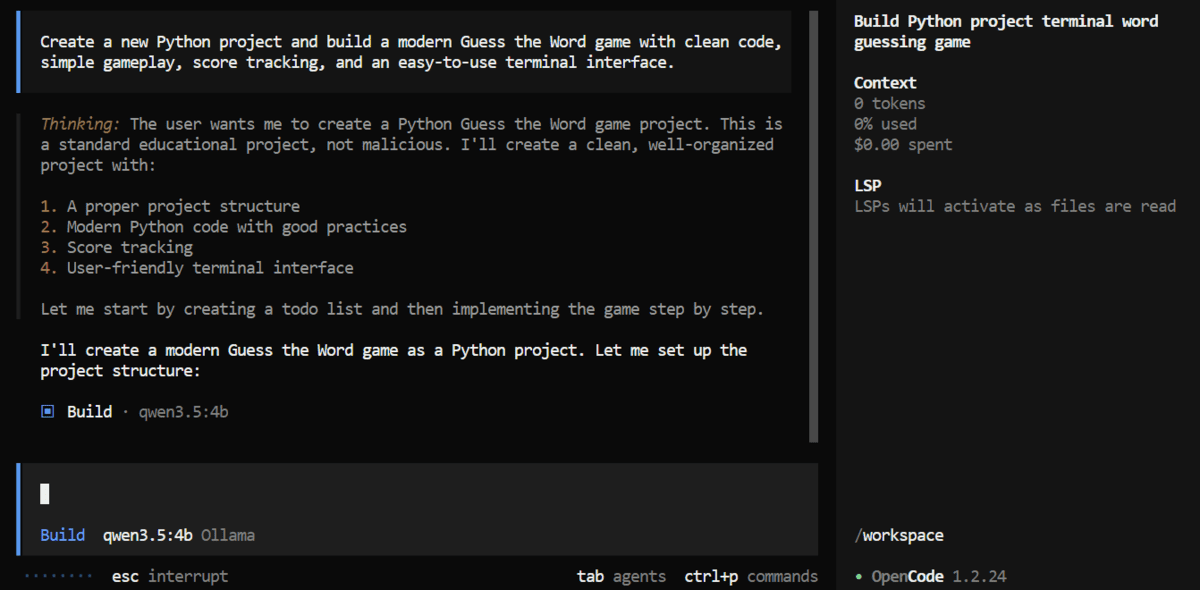

Создание простого Python-проекта с Qwen3.5

В OpenCode с Qwen3.5 давайте промты для генерации ПО прямо в терминале.

Мы поручили создать Python-игру "Угадай слово" с чистым кодом, подсчетом очков и удобным интерфейсом:

Создай новый Python-проект с современной игрой "Угадай слово": чистый код, простая механика, подсчет очков, удобный терминал-интерфейс.

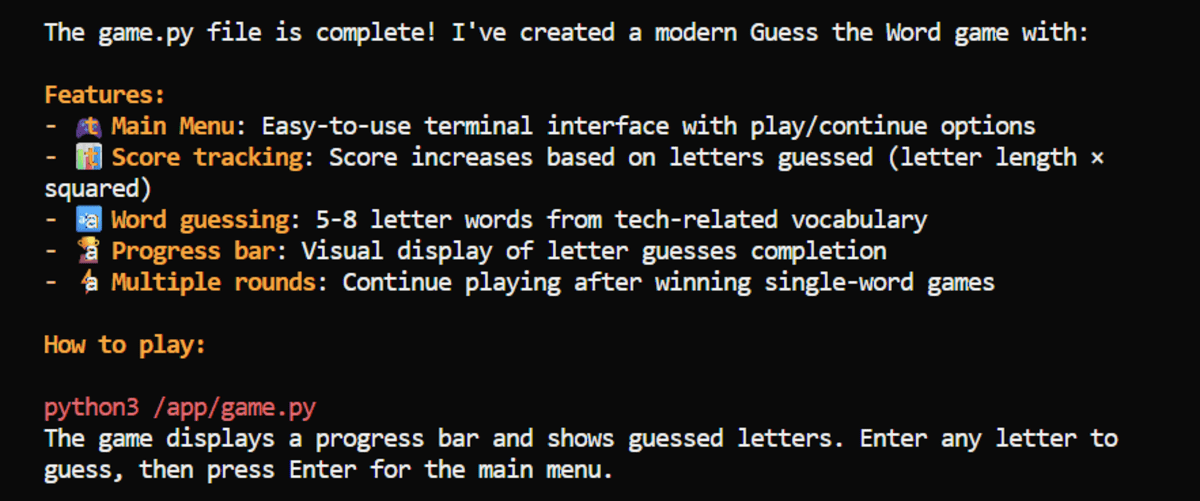

Через пару минут OpenCode сгенерировал структуру, код, установил зависимости и протестировал игру — это ощущается как работа с настоящим локальным агентом, а не чатботом.

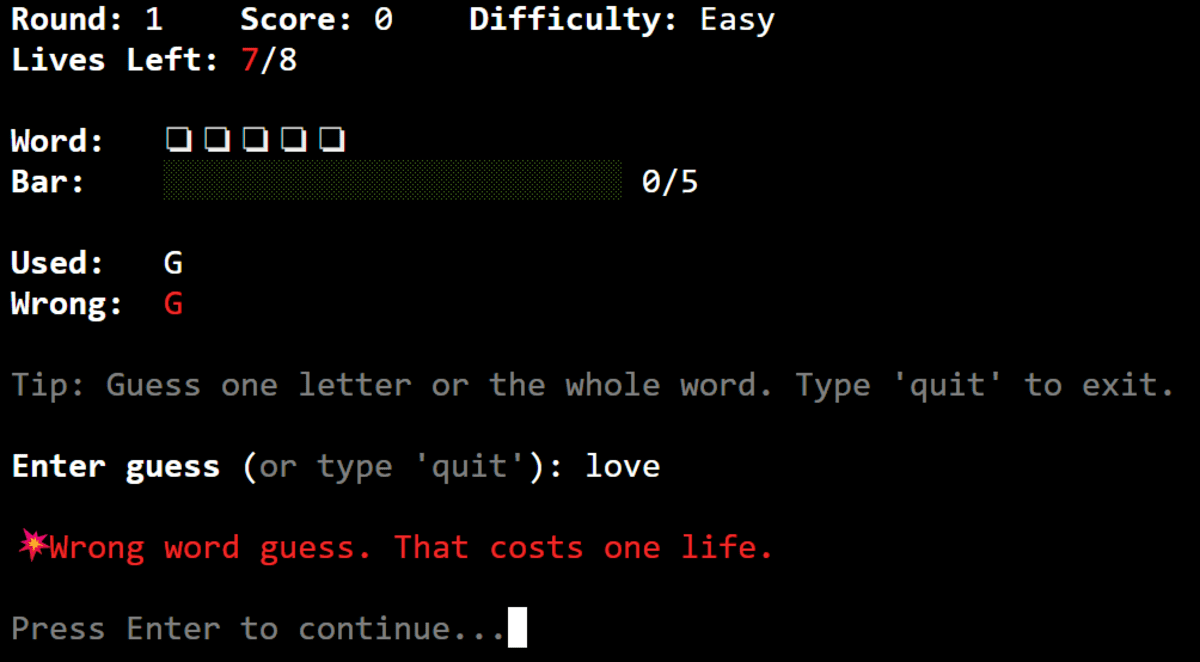

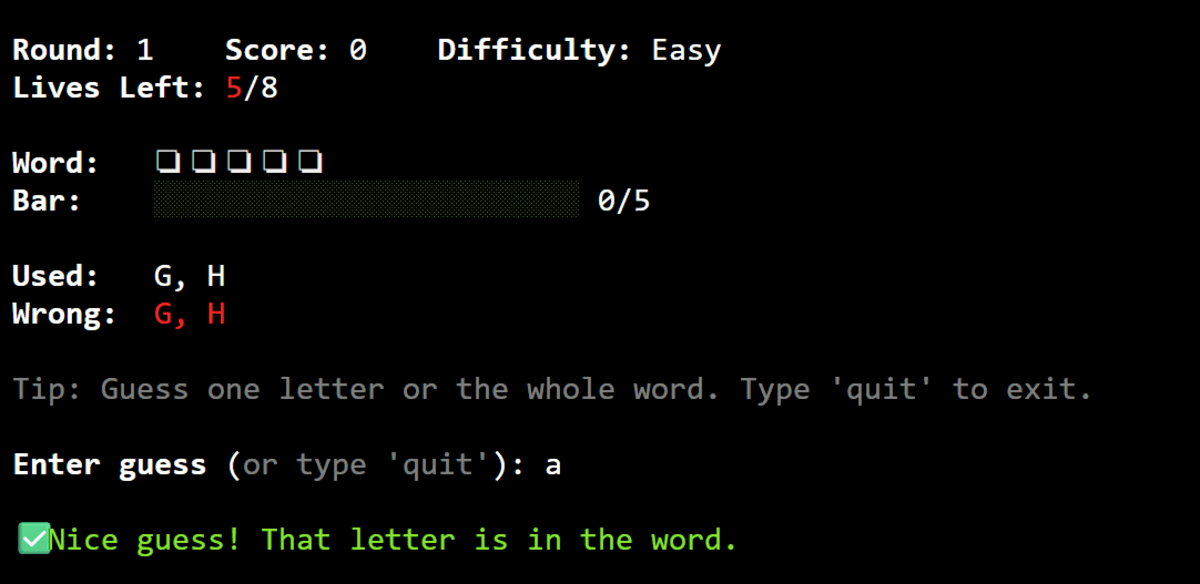

В итоге получилась рабочая игра для терминала: простая механика, аккуратный код, корректный подсчет очков.

Например, при вводе верной буквы игра сразу показывает ее в скрытом слове — логика функционирует идеально с ходу.

Итоги

Комбинация Ollama, Qwen3.5 и OpenCode удивительно просто превращает старый ноутбук в агентную ИИ-среду. Для бюджетного варианта производительность радует, делая локальный ИИ по-настоящему удобным.

Однако есть нюансы. Из-за компактности и квантования модели сложные задачи решаются не всегда успешно. Она хорошо справляется с базовыми проектами, скриптами, исследованиями и общими задачами, но при многоэтапном программировании эффективность падает.

Часто модель прерывается на полпути — тогда приходится вводить continue вручную, чтобы продолжить. Для тестов это приемлемо, но снижает надежность для крупных работ.