Графовые нейронные сети (GNN) — один из самых мощных и быстро прогрессирующих подходов в глубоком обучении. В отличие от прямых сетей или сверточных нейронных сетей, они специально заточены под данные в формате графа: узлы обозначают объекты, а ребра — связи между ними.

GNN идеально подходят для задач из реальной жизни, таких как анализ социальных сетей, системы рекомендаций, поиск мошенничества, прогнозирование свойств молекул и материалов, выводы в графах знаний, а также моделирование транспортных или коммуникационных сетей.

Здесь мы разберем пять свежих достижений в области GNN, на которые стоит обратить внимание в ближайшее время. Особое внимание уделим тому, почему эти направления актуальны именно сейчас.

# 1. Динамические и потоковые графовые нейронные сети

Динамические GNN выделяются изменяющейся структурой графа, что позволяет им справляться не только с эволюцией связей, но и с обновлением атрибутов узлов. Такие сети часто применяют для обучения представлений на графовых данных, например, в социальных сетях.

Сегодня их ценят за способность решать сложные задачи прогнозирования в реальном времени: от потоковой аналитики и моментального обнаружения фрода до слежения за сетями трафика, биологическими процессами и улучшения рекомендаций в онлайн-магазинах или стриминговых сервисах.

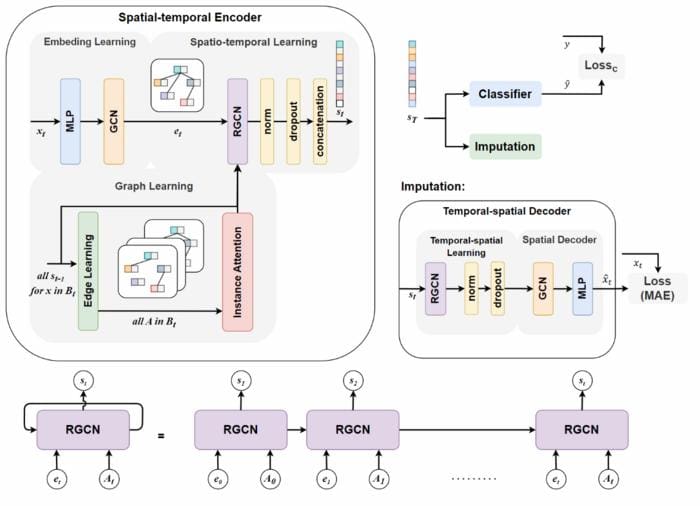

Недавняя статья демонстрирует применение динамических GNN для обработки нерегулярных многомерных временных рядов — данных, с которыми статичные модели не справляются. Разработчики добавили механизм внимания к экземплярам, который подстраивается под графики с разной частотой обновлений.

Подробнее о базовых принципах динамических GNN можно почитать здесь.

# 2. Масштабируемое слияние признаков высокого порядка

Сейчас набирает обороты переход от "мелких" GNN, которые видят только ближайших соседей, к моделям, способным улавливать дальние зависимости. Это реализуется через масштабируемое слияние признаков высокого порядка, что избавляет от проблем вроде переглаживания — когда после нескольких шагов распространения информация размывается.

Такие методы дают моделям глобальное понимание закономерностей в больших данных, например, при анализе взаимодействий белков в биологии. Плюс они экономят память и вычисления, делая GNN мощным инструментом для точных прогнозов.

Свежая работа предлагает новый фреймворк: он адаптивно объединяет признаки из нескольких "прыжков" по графу, обеспечивая эффективное и масштабируемое обучение.

# 3. Интеграция адаптивных графовых нейронных сетей с большими языковыми моделями

В 2026 году интеграция GNN и больших языковых моделей (LLM) выходит из лабораторий в промышленность. Это позволяет обрабатывать данные, где важны как графовые связи, так и естественный язык.

Потенциал в создании умных агентов ИИ, которые не просто угадывают по словам, а используют GNN как "навигатор" по контексту, правилам и истории данных для обоснованных решений. Например, модель может выявлять сложные схемы мошенничества, а LLM — объяснять логику на человеческом языке.

Направление затрагивает и генерацию с дополнением поиском (RAG). Об этом в недавнем исследовании: легковесные GNN заменяют дорогие обхода графов на базе LLM, быстро находя релевантные многопрыжковые пути.

# 4. Междисциплинарные применения графовых нейронных сетей: материаловедение и химия

С усложнением архитектур GNN укрепляют позиции в научных открытиях: предсказания в реальном времени становятся дешевле, а старые симуляции уходят на второй план.

В химии и материаловедении это проявляется в исследовании огромных химических пространств для создания устойчивых технологий, вроде новых материалов для батарей. Результаты близки к экспериментальным при предсказании сложных свойств.

Пример — исследование в Nature, где передовые GNN прогнозируют высокопроизводительные свойства кристаллов и молекул.

# 5. Устойчивость и сертифицированная защита для безопасности графовых нейронных сетей

В 2026 году фокус на безопасности GNN и гарантированных защитах растет. Модели должны выдерживать хитрые атаки, особенно в критической инфраструктуре вроде энергосетей или финансовых систем для борьбы с фродом.

Современные фреймворки вроде AGNNCert и PGNNCert математически доказывают защиту от тонких атак на структуру графа.

А вот свежая работа предлагает защиту без переобучения и привязки к модели — универсальный подход для повышения надежности GNN.

В итоге механизмы безопасности GNN критически важны для надежного внедрения в регулируемые и опасные системы.

Итоги

Мы рассмотрели пять направлений в графовых нейронных сетях, которые стоит отслеживать в 2026 году. Повышение эффективности, аналитика в реальном времени, многопрыжковое мышление с LLM, ускорение открытий в науке и безопасное применение в реальности — вот почему эти прорывы так значимы.